Abstract(摘要)

新提出的WTConv(小波卷积)可以获得非常大的感受野而不会受到过度参数化的影响。

Discussion(讨论)

使用WTConv,我们可以以纯卷积方法配置全局感受野的空间混合。

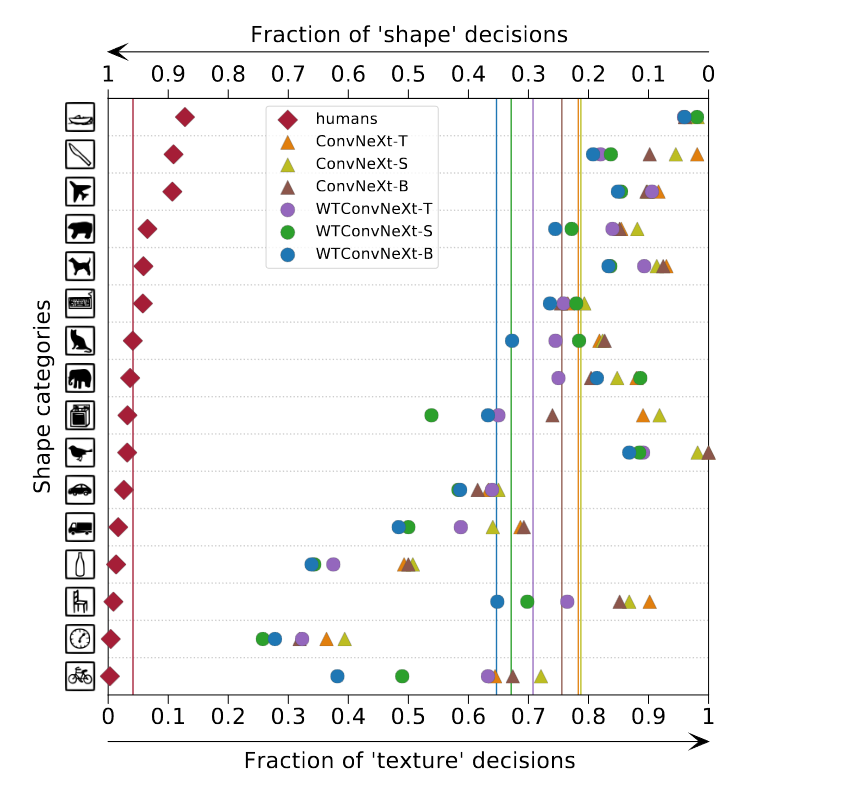

WTConv 大大增加了 CNN 的有效感受野,改善了 CNN 的形状偏差,使网络对损坏更加鲁棒,并为各种视觉任务提供了更好的性能。

Limitations(限制)

运行时间在现有框架内相对较高,这是由于多个顺序操作(WT-conv-IWT)的开销造成的,这可能比本身的成本更高。

可以通过使用专门的实现来缓解,例如,在每个级别中与卷积并行执行 WT 以减少内存读取,或就地执行 WT 和 IWT 以减少内存分配。

Introduction(导言)

一开始,大家认为vit的多头自注意力层有利于特征的全局混合,而卷积在结构上仅限于特征的局部混合。(性能差距)为了弥补性能差距,把卷积核增大到7×7大小,但是内核会变得过度参数化,并且在达到全局感受野之前性能会饱和。

发现,使用较大的内核使 CNN 的形状偏差更大,这意味着它们捕获图像中低频的能力得到了提高。但是卷积层通常倾向于响应输入中的高频。而注意力头更适合低频。

所以

idea:利用时频分析中的小波变换(WT),使卷积的感受野能够很好地放大,并通过级联引导 CNN 更好地响应低频。

movivation:保留了一定的空间分辨率,这使得空间运算(比如卷积)更加有意义。

提出了 WTConv,该层使用级联 WT 分解并执行一组小核卷积,每个卷积都专注于越来越大的感受野中输入的不同频段。这个过程使我们能够更加重视输入中的低频,同时仅添加少量可训练参数。(感受野大,参数量少)

对于k×k感受野,参数量随k呈对数增长。

To summarize, our key contributions are:(主要贡献)

– A new layer, called WTConv, that uses the WT to increase the receptive field of convolutions effectively. (有效地增加卷积的感受野)

– WTConv is designed to be a drop-in replacement (for depth-wise convolutions) within given CNNs. (WTConv可替代CNN的Conv)

– Extensive empirical evaluation demonstrates that WTConv improves CNNs’ results in several key computer-vision tasks. (改善cv任务的结果)

– Analysis of WTConv’s contribution to CNN’s scalability, robustness, shapebias, and ERF.(可扩展性、鲁棒性)

Methods(方法)

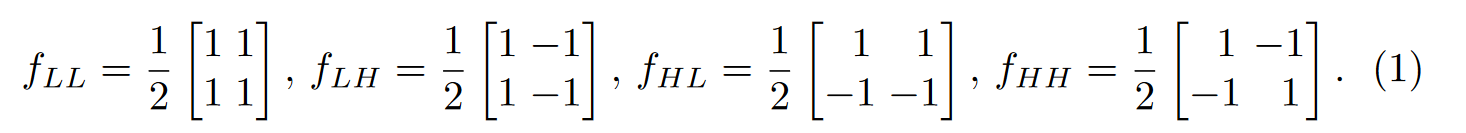

Preliminaries: The Wavelet Transform as Convolutions(小波变换)

我们在两个维度上操作,使用以下四个滤波器组产生步幅为 2 的深度卷积:

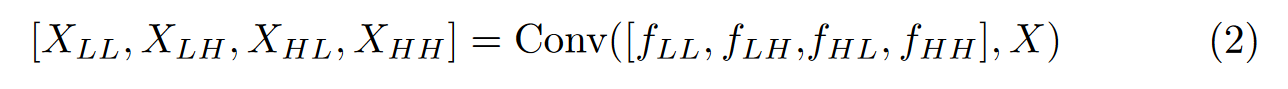

fLL为低通滤波器,其余三个为高通滤波器,对于每个输入通道,卷积的输出:

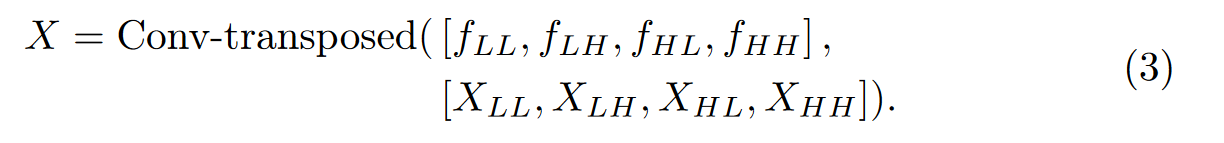

XLL 是 X 的低频分量,而 XLH 、 XHL 、 XHH 是其水平、垂直和对角高频分量。由于公式(1)中形成了正交基,所以应用小波逆变换(IWT)通过转置卷积得到X:

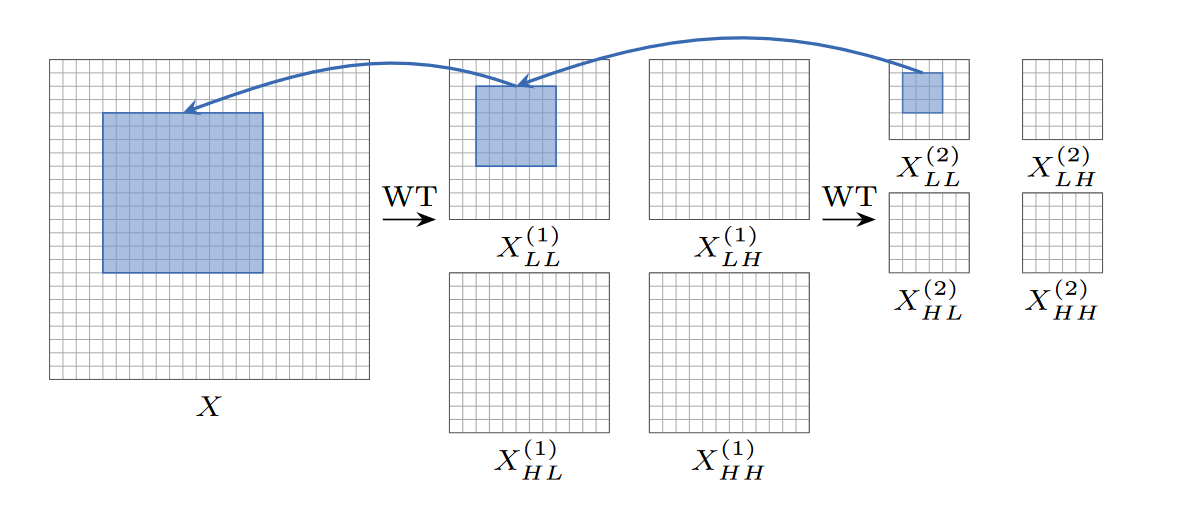

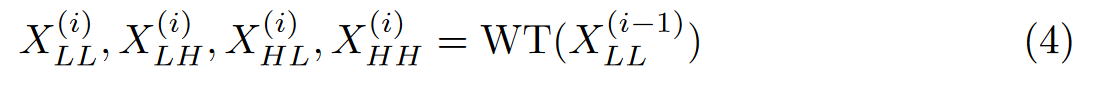

然后通过递归分解低频分量给出级联小波分解。每个分解级别由下式给出:

由迭代分解低频分量可以分析出,小波变换更加关注于低频,较低频率的频率分辨率增加,空间分辨率降低。输入低频的重复小波变换分解强调了它们并增加了层的相应响应。

Convolution in the Wavelet Domain(小波域中的卷积)

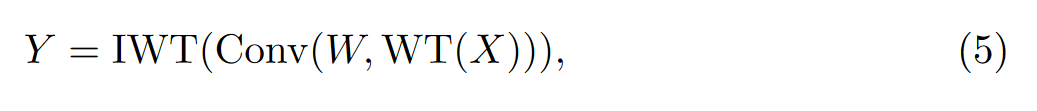

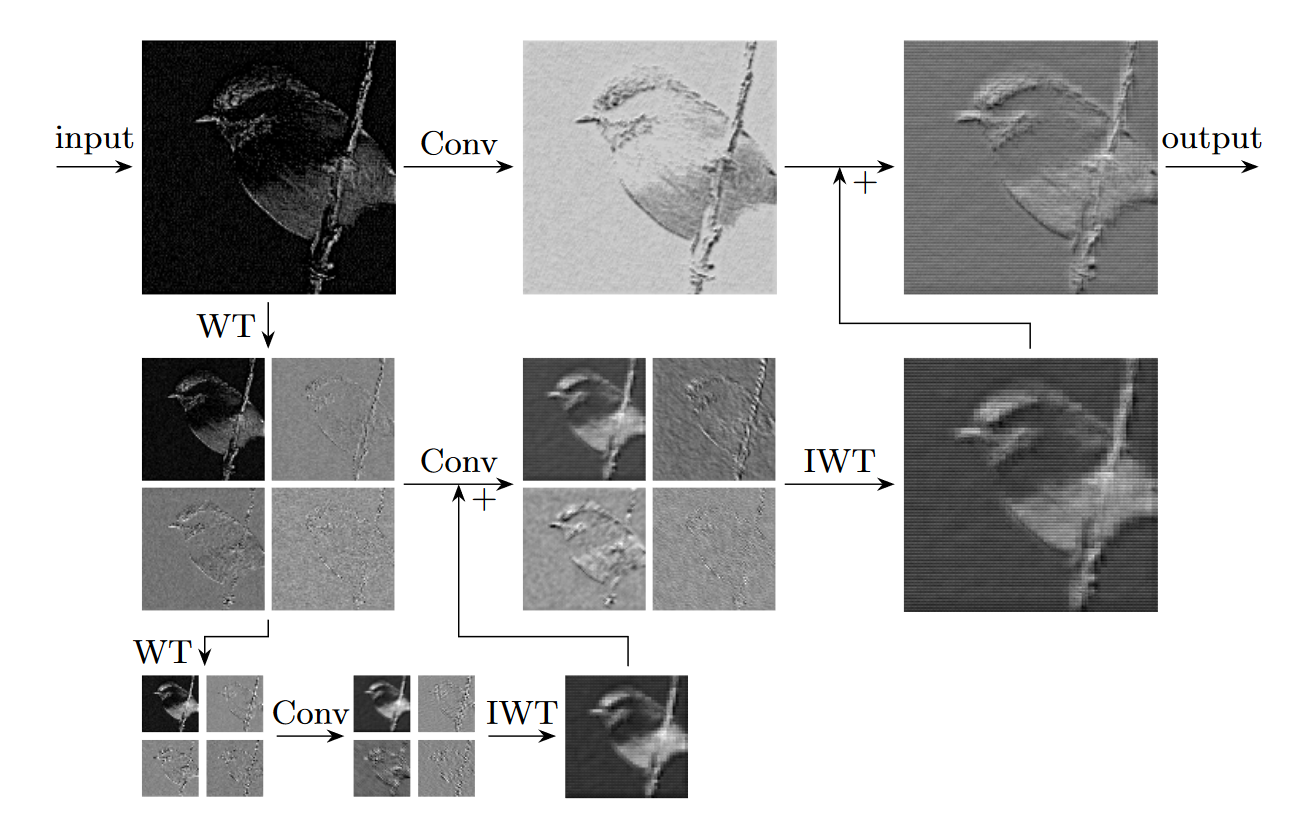

已知,增加卷积核的大小时参数量以2次方增长,为了缓解这种情况,使用小波变换来过滤和缩小输入的低频和高频内容。然后,在使用 IWT 构造输出之前,对不同频率图执行小内核深度卷积。

X 是输入张量,W 是 k × k 深度内核的权重张量,其输入通道数是 X 的四倍。(刚好和分离出来的不同频率分量的卷积相匹配)该操作分离了频率分量之间的卷积,还允许较小的内核在原始输入的较大区域中进行操作。

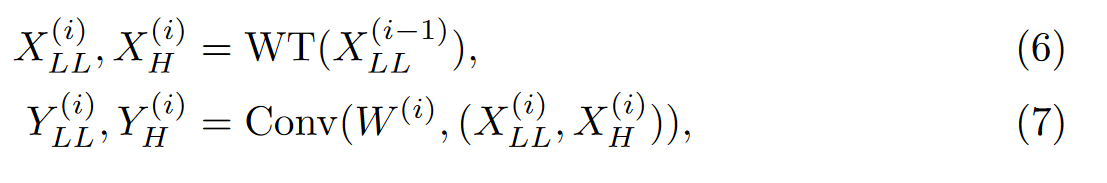

采用该 1 级组合运算,并使用等式 1 中相同的级联原理进一步增加等式4,该过程由下式给出:

X(0) LL 是层的输入,X(i) H 表示级别 i 的所有三个高频图X(i)LH,X(i)HL,X(i)HH。

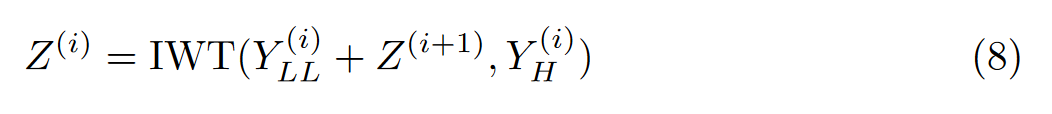

为了组合不同频率的输出, WT 及其逆是线性运算,意味着 IWT(X + Y ) = IWT(X) + IWT(Y ),所以得到:

Z(i) 是从级别 i 开始的聚合输出。不同大小卷积的两个输出相加作为输出。

例:使用 2 级小波分解和 3 × 3 卷积核大小。

不能对 Y (i) LL 、 Y (i) H 中的每一个进行归一化,因为它们的单独归一化并不对应于原始域中的归一化。仅执行通道缩放来权衡每个频率分量足够。

The Benefits of Using WTConv(使用WTConv的好处)

将 WTConv 合并到给定的 CNN 中有两个主要的技术优势:

- WT 的 l 级级联频率分解,与每个级别的固定大小内核 k 一起,允许参数数量在级别数中线性缩放而感受野呈指数增长。

- WTConv 层的构建比标准卷积更好地捕获低频。因为输入低频的重复小波变换分解强调了它们并增加了层的相应响应。

Computational Cost(计算成本)

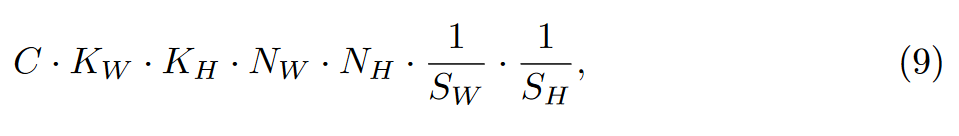

深度卷积的计算成本为

其中 C 是输入通道数,(NW , NH ) 是输入的空间维度,(KW , KH ) 是内核大小,(SW , SH ) 是每个维度的步幅。

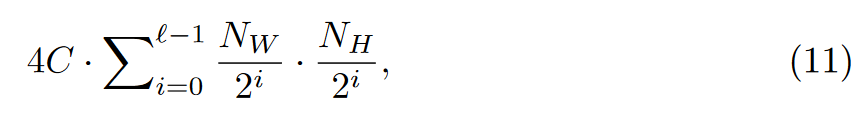

通过使用标准卷积运算的简单实现,WT 的 FLOP 计数为

因为四个内核的大小为 2×2,每个空间维度上的步幅为 2,并且在每个输入通道上运行。

比较起来,这仍然比类似感受野的标准深度卷积节省了很多。

Results(结果)

形状偏差

形状偏差与人类的感知有关,被认为是比较理想的。

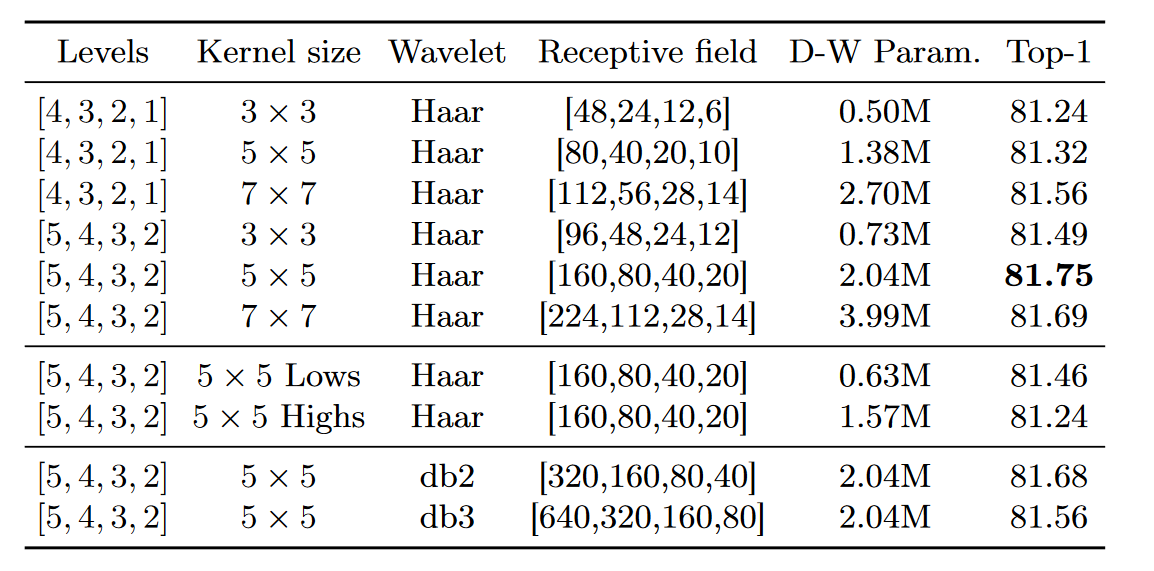

消融实验